Confiance en IA génératives : perception et adoption

💡 En résumé : La confiance des utilisateurs envers les IA génératives varie considérablement selon la familiarité, le pays et la culture numérique. Le rapport du Reuters Institute révèle que des outils comme ChatGPT et Gemini inspirent davantage de confiance, tandis que des IA moins connues n’ont pas encore su s’imposer. Les préoccupations en matière d’éthique et de désinformation influencent également la perception des outils d’IA dans différents contextes culturels.

Une analyse approfondie du rapport

Publié en octobre 2025, le Generative AI and News Report, du Reuters Institute et de l’Université d’Oxford, offre une analyse fascinante de la perception du public envers les outils d’IA générative. S’appuyant sur une enquête réalisée avec plus de 12 000 participants issus de six pays (France, Royaume-Uni, Danemark, États-Unis, Japon et Argentine), ce rapport examine la notoriété, l’utilisation et la crédibilité accordée à divers systèmes d’IA.

Le but est de donner un aperçu sur comment ces technologies, de plus en plus intégrées dans la production et la consommation d’informations, sont perçues. Cela soulève des questions cruciales concernant leur fiabilité et leur rôle dans le paysage médiatique contemporain.

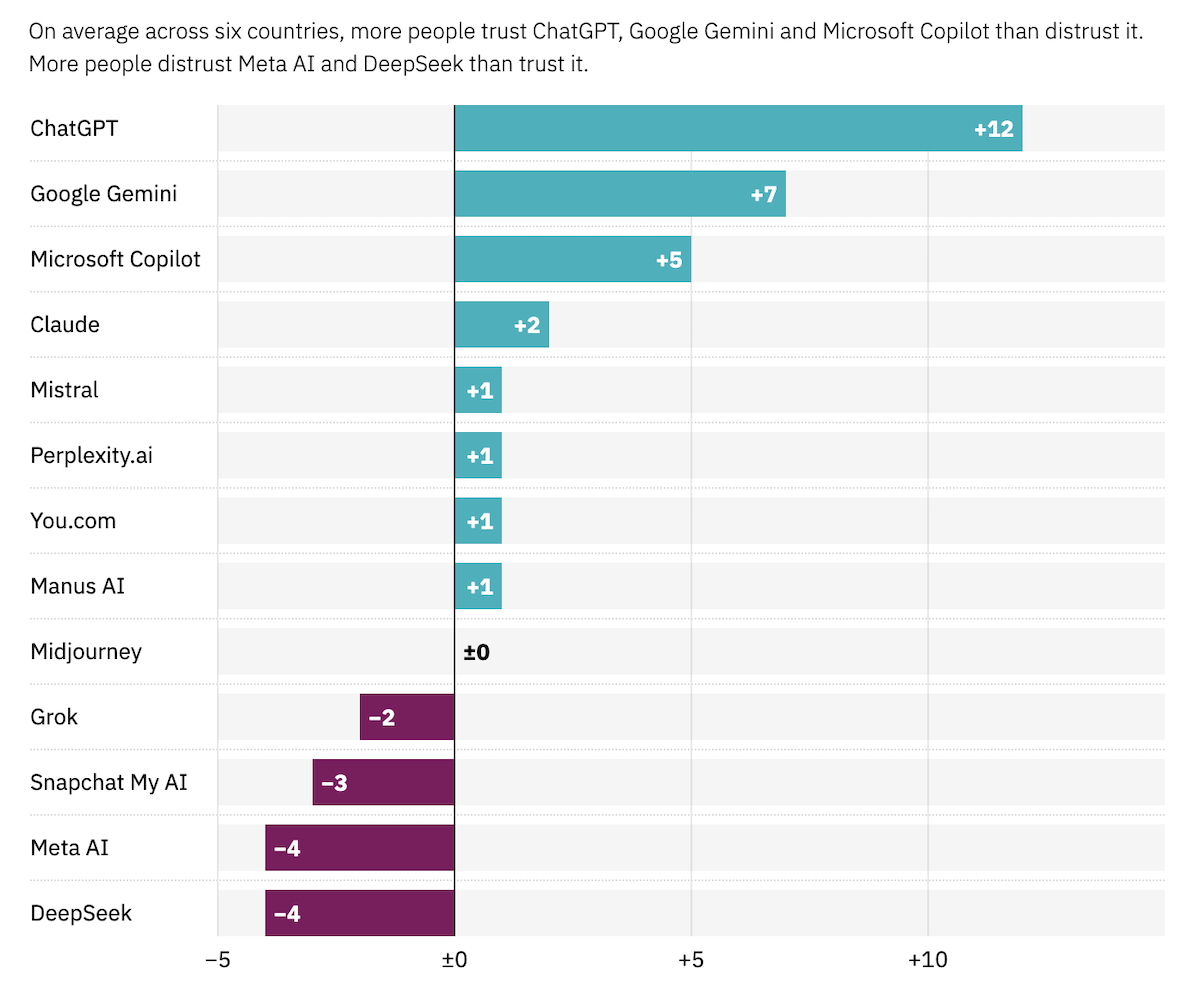

Confiance concentrée sur quelques acteurs dominants

Toutes les intelligences artificielles génératives ne suscitent pas le même degré de confiance. Selon le rapport, des outils tels que ChatGPT capturent la plupart des opinions positives. En moyenne, près d’un tiers des répondants à l’échelle mondiale affirment leur confiance envers ChatGPT, un score qui dépasse de loin celui des autres systèmes.

Par exemple, Gemini de Google recueille environ un cinquième des soutiens, tandis que d’autres comme Copilot et Meta AI oscillent entre 10 et 12 %. À l’opposé, des modèles comme Claude, Perplexity ou Grok ont du mal à sortir du lot en raison de leur faible visibilité. Cela illustre que la familiarité joue un rôle clé dans l’établissement de cette confiance, les outils intégrés dans des services courants comme les moteurs de recherche étant perçus comme plus fiables.

Familiarité et adoption : un lien fort

Cette tendance à faire confiance à des outils familiers confirme une observation antérieure : la confiance en une technologie suit souvent son cycle d’adoption. Les utilisateurs sont en général plus enclins à faire confiance aux technologies qu’ils utilisent fréquemment ou que des entreprises qu’ils considèrent comme stables développent. Ainsi, il n’est pas surprenant que ChatGPT et Gemini dominent le paysage, tandis que d’autres IA peinent à inspirer la même confiance.

Le rapport met également en avant que la confiance, bien qu’elle croisse, reste globalement modérée, même pour les outils les plus connus. Aucun d’eux n’atteint encore le seuil de confiance majoritaire dans les pays analysés. Cela témoigne d’une perception du public qui est partagée : bien que ces technologies soient jugées puissantes, elles sont encore considérées comme peu fiables.

Différences culturelles et perception de la confiance

Une autre dimension importante abordée par le rapport est l’impact des différences culturelles sur la confiance envers les IA génératives. Le niveau de confiance évolue différemment selon les pays, ce qui souligne l’importance de comprendre le contexte culturel et médiatique de chaque société.

Variations par pays

Les Japonais et les Argentins semblent faire partie des populations les plus confiantes concernant les IA génératives. La recherche montre qu’une majorité relative de ces répondants croient que ces technologies peuvent produire des contenus utiles, souvent rendu possible par une familiarité plus grande avec les technologies d’assistance.

En revanche, les pays européens comme la France présentent des niveaux de confiance faibles, souvent caractéritiques d’une sensibilité accrue aux questions éthiques. Les Français, se montrent particulièrement sceptiques quant à la fiabilité des systèmes d’IA dans le contexte de la production de nouvelles.

Confiance et adoption : un écart à combler

Les États-Unis occupent une position intermédiaire, où la méfiance envers les grandes entreprises technologiques influence la perception des IA génératives. Malgré une certaine familiarité avec ces outils, les utilisateurs demeurent critiques par rapport à leurs implications sociétales.

Ces résultats soulignent que la confiance en l’IA n’est pas seulement liée au taux d’adoption ou de performance perçue, mais aussi à des facteurs culturels. Dans des contextes où l’IA est perçue comme une prolongation naturelle de l’innovation, elle suscite davantage de curiosité, alors que dans des environnements plus méfiants envers la technologie, son usage est entouré d’une prudence considérable.

La majorité des participants demeurent convaincus que les IA doivent être des outils d’assistance, préférant une supervision humaine dans la production de contenus journalistiques.

| Pays | Taux de confiance (%) |

|---|---|

| Japon | 65 |

| Argentine | 60 |

| États-Unis | 45 |

| France | 30 |

| Royaume-Uni | 28 |

| Danemark | 27 |

Conclusion : vers un avenir de confiance relayée par l’expérience

En somme, le rapport du Reuters Institute met en lumière des dynamiques de confiance complexes autour des IA génératives. La familiarité des utilisateurs, le contexte culturel et les préoccupations éthiques forment un tableau riche des perceptions actuelles. Alors que la technologie continue de progresser, ces facettes de la confiance devront être explorées avec soin pour naviguer vers un avenir où l’IA pourrait jouer un rôle crucial dans la communication et l’information.

En définitive, bien que la présence des IA génératives dans notre quotidien s’intensifie, la route vers une confiance généralisée reste semée d’embûches. Les acteurs de la technologie doivent œuvrer pour améliorer la transparence, la fiabilité et l’éthique de l’IA pour gagner le cœur des utilisateurs.